شیائومی بیسروصدا گام به عرصه مدلهای زبانی بزرگ نهاده و نخستین مدل هوش مصنوعی متنباز خود با نام MiMo-7B را معرفی کرده است. این مدل به طور ویژه بر انجام وظایف پیچیده استدلال تمرکز دارد و در زمینههایی چون استدلال ریاضی و تولید کد، از رقبایی مانند OpenAI و Alibaba پیشی میگیرد.

هوش مصنوعی MiMo-7B شیائومی

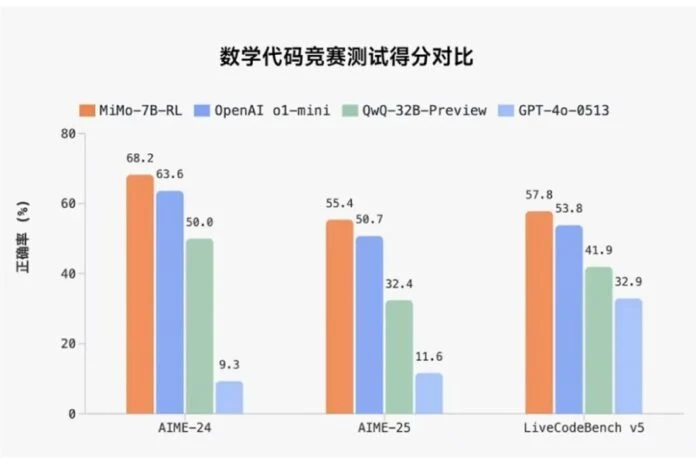

همانطور که از نام آن پیداست، MiMo-7B یک مدل با 7 میلیارد پارامتر است. شیائومی مدعی است که این مدل، علیرغم اندازه به مراتب کوچکترش در مقایسه با بیشتر مدلهای زبانی بزرگ، عملکردی در حد مدلهایی مانند o1-mini متعلق به OpenAI و Qwen-32B-Preview متعلق به شرکت Alibaba ارائه میدهد. هر سه این مدلها از قابلیت استدلال هوش مصنوعی برخوردارند.

در توسعه MiMo-7B از یک رویکرد پیشآموزشی فشرده استفاده شده است. شیائومی اعلام کرده که یک دیتابیس فشرده شامل 200 میلیارد توکن استدلالی را گردآوری کرده و در مجموع 25 تریلیون توکن را طی سه مرحله آموزش به این مدل خورانده است.

این شرکت همچنین به جای روش استاندارد پیشبینی توکن بعدی، از روش پیشبینی چند توکنی بهره برده و ادعا میکند که بدین ترتیب زمان استنتاج را بدون کاهش کیفیت خروجی، بهبود میبخشد.

فرایند پسآموزش این مدل شامل ترکیبی از تکنیکهای یادگیری تقویتی و بهینهسازیهای زیرساختی است. شیائومی از یک الگوریتم سفارشی با عنوان Test Difficulty Driven Reward برای مقابله با سیگنالهای پاداش پراکنده که اغلب وظایف یادگیری تقویتی شامل الگوریتمهای پیچیده را دچار مشکل میکنند، استفاده کرده است. به علاوه، شیائومی یک روش Easy Data Re-Sampling را برای پایدارسازی فرایند آموزش به کار گرفته است.

از نظر زیرساختی، این شرکت یک سیستم Seamless Rollout را به منظور کاهش زمان خرابی واحدهای پردازش گرافیکی (GPU) در طول مراحل آموزش و اعتبارسنجی ایجاد کرده است. نتیجه این تلاشها، بهبود 2.29 برابری در سرعت آموزش و افزایش تقریباً 2 برابری در عملکرد اعتبارسنجی بوده است. موتور این مدل نیز به گونهای طراحی شده که از راهبردهای استنتاجی نظیر پیشبینی چند توکنی در محیطهای vLLM پشتیبانی کند.

چهار نسخه عمومی از MiMo-7B وجود دارد:

- Base: مدل خام و پیشآموزش دیده

- SFT: نسخهای که با دادههای نظارتشده آموزش داده شده است

- RL-Zero: یک نوع یادگیری تقویتی که از مدل پایه شروع میشود

- RL: بر اساس نسخه SFT ساخته شده و گفته میشود بالاترین دقت را ارائه میدهد.

شیائومی برای اثبات ادعای خود اعدادی را ارائه کرده است. به گفته این شرکت، در بخش ریاضیات، نسخه MiMo-7B-RL در آزمون MATH-500 امتیاز 95.8 درصد و در AIME 2024 امتیازی بیش از 68 درصد کسب کرده است.

در بخش کدنویسی، این مدل در LiveCodeBench نسخه 5 به امتیاز 57.8 درصد و در نسخه 6 آن به امتیازی اندکی کمتر از 50 درصد دست یافته است. همچنین، در وظایف مربوط به دانش عمومی نظیر DROP، MMLU-Pro و GPQA نیز امتیازات در محدوده 50 درصد قرار دارند که برای یک مدل 7B قابل توجه است.

اکنون، MiMo-7B به صورت متنباز در Hugging Face قابل دسترس است. شما همچنین میتوانید تمامی مستندات این مدل را در GitHub مورد بررسی قرار دهید.

source