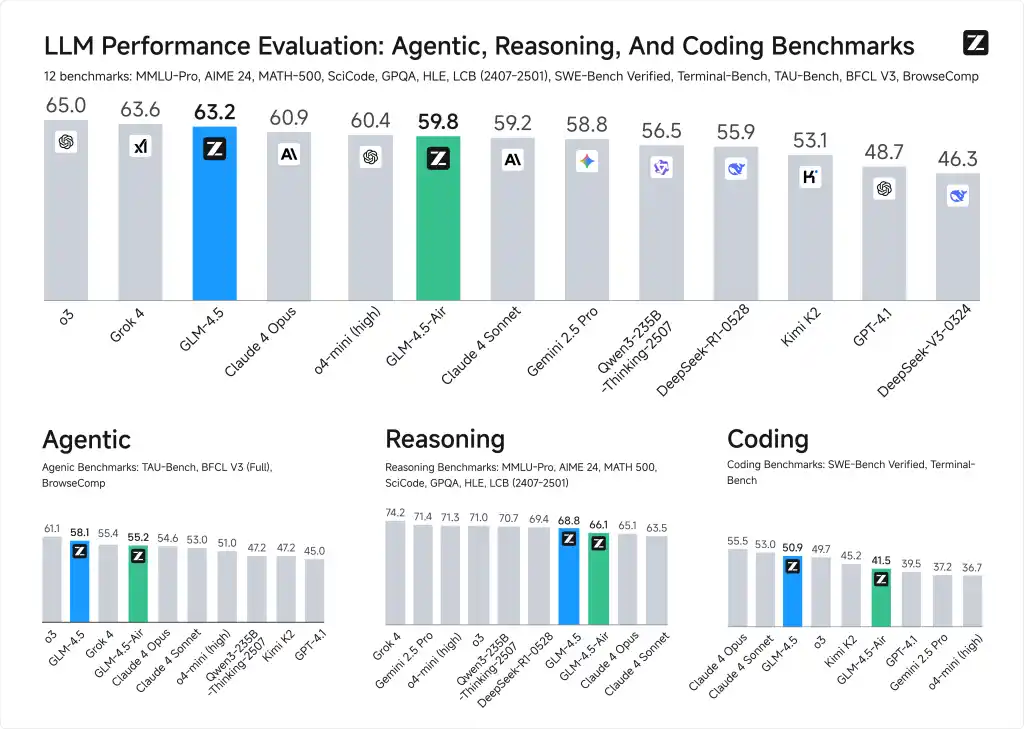

مدل GLM-4.5 با 355 میلیارد پارامتر و معماری Mixture-of-Experts، عملکردی رقابتی با GPT-4.5 و Grok-4 ارائه میدهد. این مدل متنباز با مجوز MIT، در برنامهنویسی (80.8% موفقیت) و نمایندههای هوشمند (90.6%) برتری دارد. نسخه سبکتر GLM-4.5-Air نیز برای دستگاههای کممنبع عرضه شده است.

در حالی که جهان غرب با ظهور GPT-4.5 از OpenAI و Grok-4 از xAI هیجانزده شده، رقیبی قدرتمند از شرق پدیدار شده است. مدل GLM-4.5 که توسط شرکت Zhipu AI (شناختهشده با نام Z.ai) توسعه یافته، جدیدترین نسخه از سری «مدلهای زبانی عمومی» این شرکت است و در میان پژوهشگران و توسعهدهندگان هوش مصنوعی توجه زیادی را به خود جلب کرده است.

روی کاغذ، GLM-4.5 یک شاهکار فنی محسوب میشود: دارای ۳۵۵ میلیارد پارامتر کلی (با ۳۲ میلیارد پارامتر فعال)، پشتیبانی از پنجره متنی تا ۱۲۸ هزار توکن، معماری ترکیبی «تفکری/غیرتفکری» نوآورانه و دقیقترین عملکرد در استفاده از ابزارها در میان مدلهای متنباز. در آزمونهای بنچمارک، نه تنها رقابت میکند، بلکه در بسیاری از کاربردهای دنیای واقعی، استدلال و برنامهنویسی از سایر مدلهای متنباز پیشی میگیرد.

و شاید مهمتر از همه، این مدل تحت مجوز MIT بهصورت کاملاً رایگان عرضه شده است.

GLM-4.5: معماری هوشمندانه

مدل GLM-4.5 بر پایه معماری Mixture-of-Experts (ترکیب متخصصان) ساخته شده است. این ساختار تنها بخش کوچکی از پارامترهای مدل را برای هر درخواست فعال میکند (۳۲ میلیارد از مجموع ۳۵۵ میلیارد)، که باعث میشود سطح عملکرد آن در حد GPT-4 باقی بماند اما از نظر محاسباتی بهینه و سبک باشد.

اما نوآوری برجسته این مدل، قابلیت پردازش دوحالته آن است. GLM-4.5 میتواند بین دو وضعیت «تفکری» و «غیرتفکری» جابهجا شود؛ یعنی بسته به نوع وظیفه، انتخاب میکند که استدلال چندمرحلهای عمیق انجام دهد یا پاسخ سریع و سبک ارائه دهد. نتیجه این فرآیند، پاسخهایی هوشمندتر و متنیتر است که بدون نیاز به استفاده کامل از منابع، بهینهسازی شدهاند.

برای کاربرانی که به نسخهای سبکتر نیاز دارند، Zhipu همچنین مدل GLM-4.5-Air را عرضه کرده است؛ مدلی با ۱۰۶ میلیارد پارامتر کلی و تنها ۱۲ میلیارد پارامتر فعال که برای اجرا روی GPUهای ارزانقیمت یا دستگاههای لبه طراحی شده است.

GLM-4.5: عملکرد درخشان در بنچمارکها

Zhipu AI ادعاهای بزرگ خود را با دادهها پشتیبانی کرده است. در ارزیابیهای داخلی و مستقل، GLM-4.5 در چندین حوزه پیشتاز بوده است. در تولید کد، نرخ موفقیت آن برابر با ۵۳.۹٪ در مقایسه با رقبا و نرخ شگفتانگیز ۸۰.۸٪ در آزمونهای تخصصی برنامهنویسی گزارش شده است.

در بنچمارکهای نمایندههای هوشمند که شامل فراخوانی API، خواندن اسناد یا جستجو در وب بودند، GLM-4.5 به نرخ موفقیت ۹۰.۶٪ دست یافت که بالاتر از بسیاری از مدلهای بسته و متنباز ثبتشده است. پشتیبانی از ۱۲۸ هزار توکن نیز آن را همتراز با Claude 3 و GPT-4 در نگهداری مکالمات طولانی و تحلیل چندسندی قرار میدهد.

در برخی مقایسههای داخلی، Zhipu AI این مدل را تنها پس از Grok-4 از xAI و مدل o3 از OpenAI قرار داده است.

GLM-4.5: متنباز، بدون محدودیت

اهمیت GLM-4.5 فراتر از مشخصات فنی آن است. در زمانی که بیشتر مدلهای پیشرفته پشت APIها یا سقفهای مصرفی قفل شدهاند، Zhipu این مدل را بهصورت کامل و متنباز عرضه کرده است. این مدل در پلتفرم Hugging Face میزبانی شده و برای استفاده سازمانی نیز آماده است.

این بدان معناست که هر توسعهدهنده، استارتاپ یا آزمایشگاه پژوهشی میتواند مدل را تنظیم مجدد، تعبیه یا استقرار دهد بدون اینکه نگران موانع قانونی یا صدور مجوز باشد. و با توجه به عملکرد آن، GLM-4.5 میتواند به مدل پایه پیشفرض برای بسیاری از برنامههای جدید هوش مصنوعی، بهویژه در زمینه عاملهای خودگردان یا مدلهایی با قابلیت استفاده از ابزار تبدیل شود.

مجوز MIT همچنین استفاده تجاری از این مدل را تسهیل میکند. گزارشهای اولیه نشان میدهند که غولهای فناوری چینی و حتی چندین تیم پژوهشی اروپایی در حال بررسی راههای ادغام این مدل در پروژههای خود هستند.

آینده روشن برای Zhipu AI

شرکت Zhipu AI که مقر آن در پکن است و یکی از شاخههای آزمایشگاه نوآوری دانشگاه Tsinghua محسوب میشود، تاکنون چندین مدل هوش مصنوعی در سطح جهانی منتشر کرده، از جمله GLM-3 و ChatGLM، و حالا GLM-4.5 را به این مجموعه افزوده است.

با اشارههایی که به توسعه GLM-5 شده و مجموعه در حال رشد ابزارهای مبتنی بر عامل، بهنظر میرسد Zhipu در مسیر تبدیل شدن به یک رهبر جهانی در عرصه هوش مصنوعی متنباز و با عملکرد بالا قرار دارد. و در زمانی که نگرانیهای ژئوپلیتیکی درباره مدلهای بسته غربی افزایش یافته، زمانبندی آنها نیز کاملاً بهجا بهنظر میرسد.

source